Crawl Budget là gì? Dùng CDN có ảnh hưởng Crawl Budget không?

Crawl Budget là một trong những yếu tố kỹ thuật quan trọng nhưng thường bị bỏ qua trong SEO, đặc biệt với các website lớn hoặc có tần suất cập nhật cao. Việc sử dụng CDN ngày càng phổ biến để tối ưu tốc độ và hiệu suất tải trang, nhưng nhiều người vẫn băn khoăn: CDN có ảnh hưởng đến Crawl Budget của Google hay không? Bài viết này Bizfly Cloud sẽ giúp bạn hiểu rõ Crawl Budget là gì, cách Google phân bổ ngân sách crawl và vai trò thực sự của CDN trong quá trình bot thu thập dữ liệu website.

Crawl Budget là gì?

Crawl Budget là tổng số lượng URL mà Googlebot dự kiến thu thập

Crawler Budget, hay còn gọi là “ngân sách lập chỉ mục”, là một khái niệm quan trọng trong SEO, đề cập đến số lượng trang mà các bot của công cụ tìm kiếm như Google có thể hoặc sẽ lập chỉ mục trong một khoảng thời gian nhất định cho một website cụ thể. Nói cách khác, Crawl Budget xác định giới hạn về các URL mà bot có thể truy cập và thu thập dữ liệu từ website của bạn trong quá trình thu thập thông tin, đánh giá và xếp hạng.

Với các website lớn hoặc thường xuyên cập nhật, việc hiểu rõ về Crawl Budget giúp chủ sở hữu có thể tối ưu hóa cách các bot thu thập dữ liệu, tránh lãng phí tài nguyên vào các trang không quan trọng, từ đó nâng cao hiệu quả SEO. Tuy nhiên, nếu không quản lý tốt, việc phạm phải các điều kiện gây giảm Crawl Budget có thể khiến các nội dung mới hoặc quan trọng không được lập chỉ mục nhanh, ảnh hưởng tiêu cực đến thứ hạng và khả năng cạnh tranh trên các công cụ tìm kiếm hơn nữa.

Vì sao Crawl Budget ảnh hưởng trực tiếp đến SEO và tốc độ index?

Crawl Budget là một yếu tố mà các nhà phát triển và chuyên gia SEO cần chú ý bởi vì nó ảnh hưởng mạnh mẽ đến khả năng các trang của bạn được Google và các bot khác phát hiện, lập chỉ mục và hiển thị trong kết quả tìm kiếm. Nếu Crawl Budget bị giới hạn hoặc bị tiêu hao quá nhiều vào các URL không quan trọng, thì các nội dung tiềm năng, mới cập nhật, hoặc trang chủ của bạn sẽ bị bỏ lỡ cơ hội lên top.

Trong thực tế, khi Crawl Budget bị hạn chế, tốc độ Google thu thập dữ liệu cho các trang quan trọng của website cũng sẽ chậm đi. Điều này nghĩa là các cập nhật mới không được biết đến nhanh chóng, các sản phẩm mới, bài viết, hoặc các dịch vụ mới không thể xuất hiện đầy đủ trong kết quả tìm kiếm. Ngược lại, một trang web có thể tận dụng tốt Crawl Budget sẽ được index nhanh hơn, có khả năng xếp hạng cao hơn và duy trì sự hiện diện mạnh mẽ trên hệ thống tìm kiếm, đặc biệt quan trọng trong kỷ nguyên cạnh tranh dữ liệu ngày càng khốc liệt.

3 Cách CDN có thể giúp crawl hiệu quả hơn

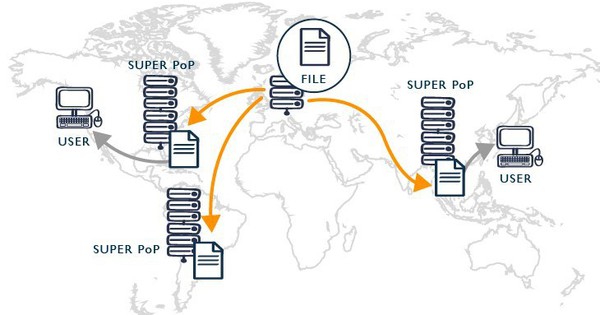

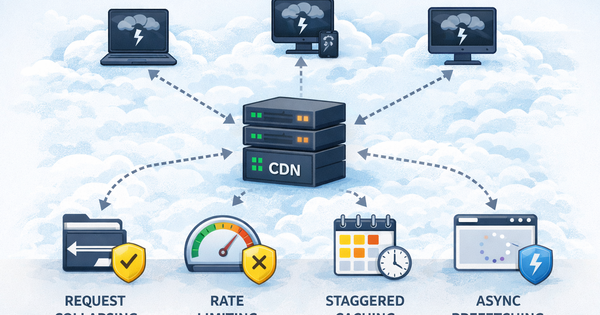

Việc sử dụng CDN (Content Delivery Network) không chỉ mang lại lợi ích về tốc độ tải trang hay giảm tải máy chủ mà còn ảnh hưởng tích cực đến cách mà bot của các công cụ tìm kiếm khám phá và thu thập dữ liệu. Dưới đây là ba cách CDN có thể tối ưu hóa hiệu quả của Crawl Budget giúp website của bạn dễ dàng được các bot "xem xét" đầy đủ, chính xác hơn.

Giảm TTFB/độ trễ khi bot truy cập

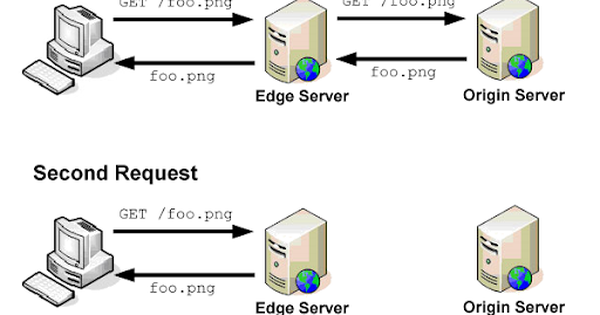

Thời gian phản hồi đầu tiên (TTFB) là một chỉ số quan trọng khi các bot của Google truy cập website của bạn. Tốc độ xử lý yêu cầu nhanh giúp bot dễ dàng duy trì lịch trình thu thập dữ liệu đều đặn, từ đó tối đa hóa được số trang có thể crawl trong hạn mức ngân sách.

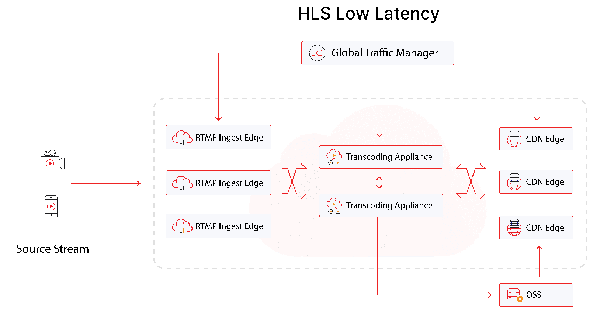

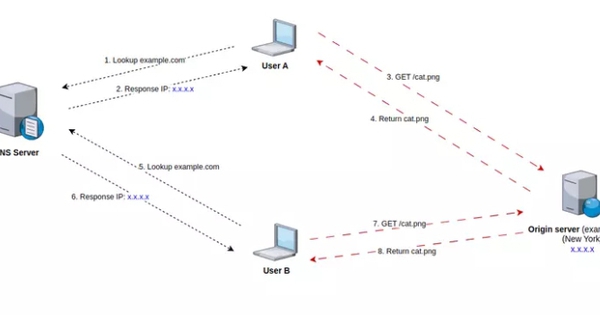

Khi sử dụng CDN, các yêu cầu của bot sẽ được xử lý tại edge server gần hơn với nguồn truy cập, giảm thời gian phản hồi đáng kể so với truy cập tới máy chủ gốc (origin server). Điều này giúp các crawler có thể đi qua nhiều URL hơn trong cùng một khoảng thời gian, từ đó tối ưu khả năng lập chỉ mục và giảm khả năng lãng phí Crawl Budget vào các trang phản hồi chậm hoặc lỗi.

Giảm tải origin, hạn chế 5xx trong peak traffic

Trong những giai đoạn cao điểm về lưu lượng truy cập, máy chủ gốc thường xuyên đối mặt với tình trạng quá tải hoặc gặp lỗi 5xx. Điều này không chỉ gây trải nghiệm người dùng không tốt mà còn ảnh hưởng tiêu cực đến crawler của Google khi họ gặp các phản hồi lỗi này. Việc này có thể dẫn đến việc Google bỏ qua hoặc giảm số lượng trang được truy cập.

CDN đóng vai trò là lớp trung gian giúp phân tán và giảm tải trên server gốc bằng cách xử lý phần lớn yêu cầu tĩnh, như hình ảnh, CSS, javascript hoặc các nội dung tĩnh khác. Khi đó, các bot đều nhận được phản hồi nhanh và ổn định hơn, giảm thiểu tỷ lệ lỗi, góp phần giữ vững hoặc gia tăng Crawl Budget dành cho các trang động, giúp các trang quan trọng được thu thập kịp thời trong thời gian tối ưu.

Phục vụ static assets ổn định

Các tệp tĩnh (static assets) như hình ảnh, CSS, JavaScript luôn chiếm phần lớn trong các website hiện đại. Việc phục vụ các tài nguyên này qua CDN không chỉ giúp giảm thời gian tải mà còn đảm bảo các bot của tìm kiếm có thể truy cập và lấy dữ liệu ổn định, không bị gián đoạn.

Khi các static assets được phân phối qua CDN, các crawler không cần phải truy cập vào máy chủ gốc để lấy dữ liệu này, giúp rút ngắn thời gian crawl và tối đa hóa nguồn lực của Crawl Budget cho các phần nội dung cần được lập chỉ mục. Đồng thời, CDN giúp giảm các tình huống tắc nghẽn, lỗi đường truyền hoặc lỗi server gây ra làm giảm hiệu quả crawl, qua đó hỗ trợ SEO bền vững hơn.

5 Tình huống CDN có thể làm crawl budget xấu đi

Bên cạnh những lợi ích rõ ràng, việc sử dụng CDN cũng tiềm ẩn các rủi ro làm giảm hiệu quả của Crawl Budget nếu không cấu hình hoặc quản lý đúng cách. Dưới đây là những tình huống phổ biến gây ra vấn đề này.

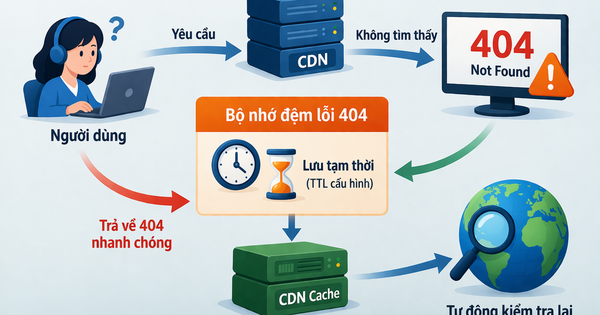

Trả sai status code hoặc 5xx tăng

Một trong các lỗi phổ biến là cấu hình CDN không chính xác dẫn đến các phản hồi sai trạng thái HTTP như 404, 302, hoặc 5xx, đặc biệt là khi các lỗi này xuất hiện trong các yêu cầu của bot lập chỉ mục. Khi Google gặp phải các phản hồi không chính xác hoặc lỗi server, nó dễ dàng bỏ qua các URL đó hoặc giảm tần suất truy cập.

Điều này khiến các trang quan trọng bị bỏ qua hoặc không được cập nhật thông tin mới, ảnh hưởng trực tiếp đến khả năng lập chỉ mục và nâng cao vị trí SERP. Vì vậy, việc cấu hình đúng các rules để tránh lỗi này là vô cùng cần thiết trong quản lý CDN.

Redirect chain do rule CDN

Redirect chain xảy ra khi các URL phải trải qua nhiều lần redirect trước khi đến đích cuối cùng, và điều này càng phức tạp hơn nếu các rule CDN gây ra chuỗi redirect dài. Các trình thu thập dữ liệu của Google không thích các chuỗi redirect, đặc biệt khi quá dài hoặc không rõ ràng.

Chúng làm tốn thời gian của bot, giảm số lượng trang có thể crawl trong giới hạn nhất định của Crawl Budget. Bên cạnh đó, các redirect phức tạp còn gây ra các lỗi hoặc trì hoãn trong quá trình thu thập dữ liệu, làm ảnh hưởng tiêu cực tới khả năng đánh giá nội dung của website.

Cache-busting param tạo nhiều URL tài nguyên khác nhau

Các URL tài nguyên bị tạo ra nhiều biến thể khác nhau do các tham số cache-busting làm tăng số lượng URL cần crawler xem xét. Trong nhiều trường hợp, điều này dẫn đến Crawl Budget bị phân mảnh, khi crawler phải xử lý nhiều URL tương tự nhau mà chỉ khác tham số, gây lãng phí nguồn lực.

Điều này đặc biệt rõ ràng khi các URL này không mang giá trị nội dung mới hoặc khác biệt lớn, còn gây ra nhiều tệp trùng lặp trong dữ liệu crawler đã thu thập. Quản lý tốt các parameter này giúp giữ Crawl Budget tập trung vào các URL thực sự quan trọng.

Chặn bot nhầm

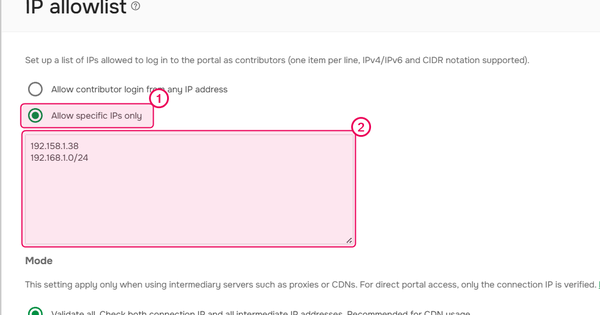

Có thể do cấu hình sai trong rules của CDN hoặc robots.txt, thiếu chính xác trong phân quyền, dẫn đến việc chặn nhầm các bot của Google hoặc các công cụ tìm kiếm khác. Thao tác này vô tình làm giảm số lượng URL mà Google có thể truy cập, qua đó giảm hiệu quả tối ưu của Crawl Budget.

Chặn không đúng cách còn làm cho các phần nội dung quan trọng không được cập nhật hoặc lập chỉ mục đúng mức, gây hạ thấp khả năng cạnh tranh trên thị trường số và giảm độ phủ của website trong các kết quả tìm kiếm.

Header canonical/robots bị rewrite sai giữa edge và origin

Trong quá trình phân phối nội dung qua CDN, các header như canonical hoặc robots có thể bị viết sai hoặc bị thay đổi không đúng cách so với origin server. Điều này dẫn đến việc các trang bị nhầm lẫn về phiên bản chính thức hoặc bị chặn không đúng.

Kết quả là Google có thể bỏ qua những nội dung quan trọng hoặc lập chỉ mục các trang không phù hợp, làm giảm hiệu quả của Crawl Budget và ảnh hưởng đến chiến lược SEO tổng thể. Chính vì vậy, cần kiểm tra và cấu hình chính xác để đảm bảo các header này được truyền đúng qua các lớp CDN.

Bizfly Cloud CDN hỗ trợ tối ưu crawl hiệu quả như thế nào?

Bizfly Cloud CDN cung cấp các tính năng tối ưu hóa phù hợp với yêu cầu của các website, giúp duy trì Crawl Budget hiệu quả nhất có thể. Với các chính sách phân phối nội dung thông minh, chỉnh sửa header chính xác, và khả năng xử lý các rule redirect, cache, cùng with ổn định về tốc độ, Bizfly Cloud CDN giúp hạn chế tối đa các vấn đề gây giảm Crawl Budget.

Hệ thống này còn giúp dễ dàng cấu hình các rules về caching và xử lý lỗi, hạn chế redirect chuỗi, tối ưu URL và kiểm soát các tham số URL tạo ra sự phân mảnh. Các tiêu chuẩn bảo mật, quản lý chatbot chính xác, và hỗ trợ các xác thực chuẩn cũng giúp website của bạn duy trì được sự truy cập ổn định, tăng khả năng Google crawl đúng lượng và đúng trang cần thiết.

Kết luận

Có thể nói rằng Crawl Budget là một yếu tố không thể xem nhẹ, đặc biệt đối với các website lớn hoặc hay cập nhật nội dung. Hiểu đúng về cách sử dụng CDN đúng cách để tối ưu hóa crawl là một chiến lược thông minh, giúp mở rộng khả năng hiển thị, giảm thiểu các rủi ro về lỗi, redirect, hoặc cấu hình sai lệch.

Việc chọn đúng nhà cung cấp CDN, như Bizfly Cloud, cùng với quản lý kỹ thuật chặt chẽ sẽ giúp website của bạn duy trì Crawl Budget hiệu quả, đảm bảo các nội dung mới, quan trọng luôn được index kịp thời. Từ đó, nâng cao hiệu quả SEO, tăng thứ hạng trang web và giữ vững vị thế cạnh tranh trong thế giới số ngày càng phát triển.